- Python人工智能教程

- 首页

- Python人工智能——基础概念

- Python人工智能——入门

- Python人工智能——机器学习

- Python人工智能——数据准备

- 监督学习:分类

- 监督学习:回归

- Python人工智能——逻辑编程

- 无监督学习:聚类

- 自然语言处理

- Python人工智能——NLTK包

- 时间序列数据分析

- Python人工智能——语音识别

- Python人工智能——启发式搜索

- Python人工智能——游戏

- Python人工智能——神经网络

- 强化学习

- Python人工智能——遗传算法

- Python人工智能——计算机视觉

- Python人工智能——深度学习

- Python人工智能资源

- Python人工智能——快速指南

- Python人工智能——有用资源

- Python人工智能——讨论

Python人工智能——神经网络

神经网络是并行计算设备,试图对大脑进行计算机建模。其主要目标是开发一个比传统系统更快地执行各种计算任务的系统。这些任务包括模式识别和分类、逼近、优化和数据聚类。

什么是人工神经网络(ANN)?

人工神经网络(ANN)是一种高效的计算系统,其核心思想借鉴了生物神经网络的类比。ANN 也被称为人工神经系统、并行分布式处理系统和连接主义系统。ANN 获取大量相互连接的单元,以某种模式允许它们之间进行通信。这些单元,也称为节点或神经元,是并行工作的简单处理器。

每个神经元都通过连接链路与其他神经元连接。每个连接链路都与一个权重相关联,该权重包含有关输入信号的信息。这是神经元解决特定问题最有用的信息,因为权重通常会激发或抑制正在传输的信号。每个神经元都有其内部状态,称为激活信号。输出信号是在组合输入信号和激活规则后产生的,可以发送到其他单元。

如果您想详细学习神经网络,可以访问以下链接:人工神经网络。

安装有用的包

为了在 Python 中创建神经网络,我们可以使用一个强大的神经网络包,称为NeuroLab。它是一个包含基本神经网络算法的库,具有灵活的网络配置和 Python 的学习算法。您可以在命令提示符下使用以下命令安装此包:

pip install NeuroLab

如果您使用的是 Anaconda 环境,则使用以下命令安装 NeuroLab:

conda install -c labfabulous neurolab

构建神经网络

在本节中,让我们使用 NeuroLab 包在 Python 中构建一些神经网络。

基于感知器的分类器

感知器是 ANN 的构建块。如果您想了解更多关于感知器的知识,可以访问以下链接:人工神经网络

以下是构建简单的基于感知器的神经网络分类器的 Python 代码的分步执行:

导入必要的包,如下所示:

import matplotlib.pyplot as plt import neurolab as nl

输入值。请注意,这是一个监督学习的例子,因此您也必须提供目标值。

input = [[0, 0], [0, 1], [1, 0], [1, 1]] target = [[0], [0], [0], [1]]

创建一个具有 2 个输入和 1 个神经元的网络:

net = nl.net.newp([[0, 1],[0, 1]], 1)

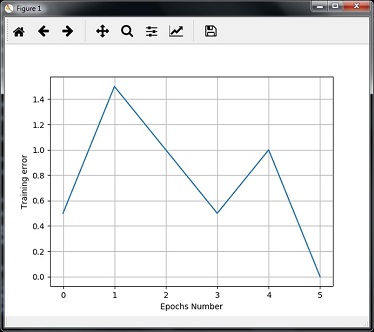

现在,训练网络。在这里,我们使用 Delta 规则进行训练。

error_progress = net.train(input, target, epochs=100, show=10, lr=0.1)

现在,可视化输出并绘制图表:

plt.figure()

plt.plot(error_progress)

plt.xlabel('Number of epochs')

plt.ylabel('Training error')

plt.grid()

plt.show()

您可以看到以下图表显示了使用误差度量进行的训练进度:

单层神经网络

在这个例子中,我们创建一个单层神经网络,它由独立的神经元作用于输入数据以产生输出组成。请注意,我们使用名为neural_simple.txt的文本文件作为输入。

导入有用的包,如下所示:

import numpy as np import matplotlib.pyplot as plt import neurolab as nl

加载数据集,如下所示:

input_data = np.loadtxt(“/Users/admin/neural_simple.txt')

以下是我们将使用的数据。请注意,在此数据中,前两列是特征,后两列是标签。

array([[2. , 4. , 0. , 0. ],

[1.5, 3.9, 0. , 0. ],

[2.2, 4.1, 0. , 0. ],

[1.9, 4.7, 0. , 0. ],

[5.4, 2.2, 0. , 1. ],

[4.3, 7.1, 0. , 1. ],

[5.8, 4.9, 0. , 1. ],

[6.5, 3.2, 0. , 1. ],

[3. , 2. , 1. , 0. ],

[2.5, 0.5, 1. , 0. ],

[3.5, 2.1, 1. , 0. ],

[2.9, 0.3, 1. , 0. ],

[6.5, 8.3, 1. , 1. ],

[3.2, 6.2, 1. , 1. ],

[4.9, 7.8, 1. , 1. ],

[2.1, 4.8, 1. , 1. ]])

现在,将这四列分成 2 个数据列和 2 个标签:

data = input_data[:, 0:2] labels = input_data[:, 2:]

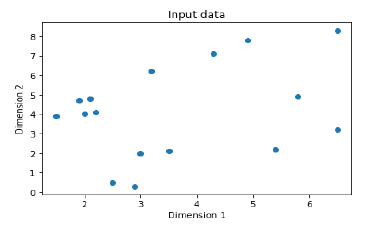

使用以下命令绘制输入数据:

plt.figure()

plt.scatter(data[:,0], data[:,1])

plt.xlabel('Dimension 1')

plt.ylabel('Dimension 2')

plt.title('Input data')

现在,定义每个维度的最小值和最大值,如下所示:

dim1_min, dim1_max = data[:,0].min(), data[:,0].max() dim2_min, dim2_max = data[:,1].min(), data[:,1].max()

接下来,定义输出层中的神经元数量,如下所示:

nn_output_layer = labels.shape[1]

现在,定义一个单层神经网络:

dim1 = [dim1_min, dim1_max] dim2 = [dim2_min, dim2_max] neural_net = nl.net.newp([dim1, dim2], nn_output_layer)

使用显示的迭代次数和学习率训练神经网络:

error = neural_net.train(data, labels, epochs = 200, show = 20, lr = 0.01)

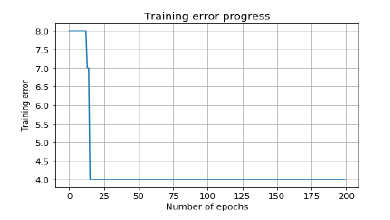

现在,使用以下命令可视化并绘制训练进度:

plt.figure()

plt.plot(error)

plt.xlabel('Number of epochs')

plt.ylabel('Training error')

plt.title('Training error progress')

plt.grid()

plt.show()

现在,在上面的分类器中使用测试数据点:

print('\nTest Results:')

data_test = [[1.5, 3.2], [3.6, 1.7], [3.6, 5.7],[1.6, 3.9]] for item in data_test:

print(item, '-->', neural_net.sim([item])[0])

您可以找到如下所示的测试结果:

[1.5, 3.2] --> [1. 0.] [3.6, 1.7] --> [1. 0.] [3.6, 5.7] --> [1. 1.] [1.6, 3.9] --> [1. 0.]

您可以看到以下图表作为迄今为止讨论的代码的输出:

多层神经网络

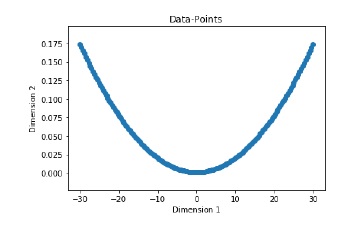

在这个例子中,我们创建一个多层神经网络,它包含多个层以提取训练数据中的底层模式。这个多层神经网络将像一个回归器一样工作。我们将根据等式:y = 2x2+8 生成一些数据点。

导入必要的包,如下所示:

import numpy as np import matplotlib.pyplot as plt import neurolab as nl

根据上面提到的等式生成一些数据点:

min_val = -30 max_val = 30 num_points = 160 x = np.linspace(min_val, max_val, num_points) y = 2 * np.square(x) + 8 y /= np.linalg.norm(y)

现在,按如下方式重塑这个数据集:

data = x.reshape(num_points, 1) labels = y.reshape(num_points, 1)

使用以下命令可视化并绘制输入数据集:

plt.figure()

plt.scatter(data, labels)

plt.xlabel('Dimension 1')

plt.ylabel('Dimension 2')

plt.title('Data-points')

现在,使用neurolab构建一个具有两层隐藏层的神经网络,第一隐藏层有十个神经元,第二隐藏层有六个神经元,输出层有一个神经元。

neural_net = nl.net.newff([[min_val, max_val]], [10, 6, 1])

现在使用梯度训练算法:

neural_net.trainf = nl.train.train_gd

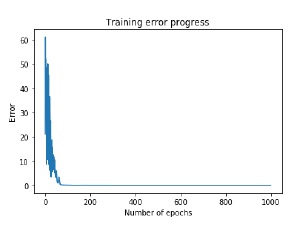

现在训练网络,目标是在上面生成的数据上学习:

error = neural_net.train(data, labels, epochs = 1000, show = 100, goal = 0.01)

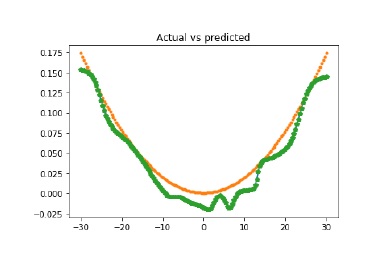

现在,在训练数据点上运行神经网络:

output = neural_net.sim(data) y_pred = output.reshape(num_points)

现在进行绘图和可视化任务:

plt.figure()

plt.plot(error)

plt.xlabel('Number of epochs')

plt.ylabel('Error')

plt.title('Training error progress')

现在我们将绘制实际输出与预测输出:

x_dense = np.linspace(min_val, max_val, num_points * 2)

y_dense_pred = neural_net.sim(x_dense.reshape(x_dense.size,1)).reshape(x_dense.size)

plt.figure()

plt.plot(x_dense, y_dense_pred, '-', x, y, '.', x, y_pred, 'p')

plt.title('Actual vs predicted')

plt.show()

作为上述命令的结果,您可以观察到如下所示的图表: