机器学习中的多元线性回归

介绍

多元线性回归是关键的回归技术之一,它模拟了一个连续因变量与多个自变量之间的线性关系。

线性回归算法有两类:

简单−仅处理两个特征。

多元−同时处理两个以上特征。

让我们在本文中详细研究多元线性回归。

多元线性回归

多元线性回归是一种常用的预测分析方法。使用这种分析方法,您可以理解一个连续因变量与两个或多个自变量之间的关系。

自变量可以是分类变量或连续变量,例如年龄和身高(例如性别和职业)。重要的是要记住,如果给定的因变量是分类变量,则应在进行分析之前对其进行伪编码。

公式和计算

多元回归分析允许同时控制影响因变量的多个因素。可以使用回归分析来检查自变量和因变量之间的关系。

设k代表用字母x1、x2、x3……xk表示的变量的数量。

为了使用这种方法,我们必须假设我们有k个可以设置的自变量。然后这些变量将概率性地决定结果Y。

此外,我们假设Y直接依赖于变量,如

Y = β0 + β1x1 + β2x2 + · · · + βkxk + ε

它依赖于或预计变量yi

y截距决定y的斜率,因此当xi和x2都为零时,y将为0。

导致y变化的xi1和xi2的一个单位变化由回归系数1和2表示。

所有自变量的斜率系数用符号p表示。

该短语描述了模型中的随机误差(残差)。

除了k不等于1的要求外,这与简单线性回归相同,其中是标准误差。

我们有超过k个观测值,n通常远大于k。

我们测量随机变量Yi的值yi,并将自变量分配给第i个观测值的xi1、xi2……xik值。

因此,可以使用以下方程来描述模型。

Yi = β0 + β1xi1 + β2xi2 + · · · + βkxik + i for i = 1, 2, . . . , n

其中误差i是具有相同未知方差2和均值为0的独立标准变量。

线性回归和多元回归的区别

在预测复杂过程的结果时,多元线性回归优于简单线性回归。

简单线性回归可以精确地捕捉简单关系中两个变量之间的关系。但是,多元线性回归可以识别需要更深入分析的更复杂的关系。

多元回归模型使用多个自变量。它不受简单回归方程的相同限制,因为它可以拟合曲线和非线性关系。多元线性回归的用途如下。

控制和规划。

预测

估计变量之间的关系可能很有趣也很有帮助。多元回归模型根据解释变量对预测因变量值的贡献来评估变量之间的关系,就像所有其他回归模型一样。

示例

import numpy as nm

import matplotlib.pyplot as pylt

import pandas as ps

dataset = ps.read_csv('https://raw.githubusercontent.com/mkgurucharan/Regression/master/Startups_Data.csv')

X1 = dataset.iloc[:, :-1].values

y = dataset.iloc[:, -1].values

from sklearn.compose import ColumnTransformer

from sklearn.preprocessing import OneHotEncoder

ctlo = ColumnTransformer(transformers=[('encoder', OneHotEncoder(), [3])],

remainder='passthrough')

X1 = nm.array(ctlo.fit_transform(X1))

print(X1)

from sklearn.model_selection import train_test_split

X1_train, X1_test, y_train, y_test = train_test_split(X1, y, test_size = 0.2)

from sklearn.linear_model import LinearRegression

regressor_one = LinearRegression()

regressor_one.fit(X1_train, y_train)

y_pred = regressor.predict(X1_test)

df = ps.DataFrame({'Real Values':y_test, 'Predicted Values':y_pred})

df

输出

Predicted Values has a value of 74963.60

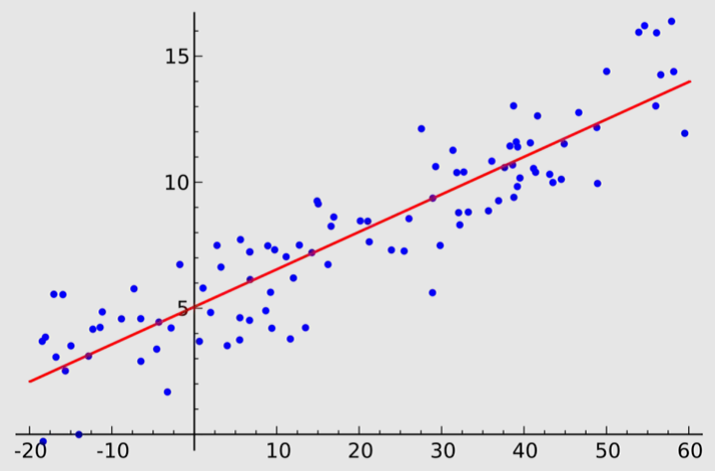

MLR 图表外观

MLR 的用法

当我们想要使用多个自变量来预测因变量时,我们使用多元回归。它与普通最小二乘法 (OLS) 回归是同一种回归。另一方面,通过根据解释变量值的改变来对比这些变量的分布,OLS 回归确定解释变量对连续因变量的影响。

MLR 允许同时使用多个解释变量。因此,您可以更准确地估计如果实施特定更改,您的数据会发生什么。

确保数据满足以下五个要求,以确保它适合线性回归分析:

因变量和自变量之间存在直线关系

自变量之间没有太大的相关性。

残差的方差始终相同。

观测的独立性(即,每个观测都应独立收集)。

多元正态性(即,所有变量都应服从正态分布)。

结论

多元线性回归是一种统计方法,用于模拟涉及两个或多个自变量和一个因变量的更复杂的关系。当存在两个或多个x变量时,使用它。

数据结构

数据结构 网络

网络 关系数据库管理系统 (RDBMS)

关系数据库管理系统 (RDBMS) 操作系统

操作系统 Java

Java iOS

iOS HTML

HTML CSS

CSS Android

Android Python

Python C语言编程

C语言编程 C++

C++ C#

C# MongoDB

MongoDB MySQL

MySQL Javascript

Javascript PHP

PHP