- TensorFlow 教程

- TensorFlow - 首页

- TensorFlow - 简介

- TensorFlow - 安装

- 理解人工智能

- 数学基础

- 机器学习与深度学习

- TensorFlow - 基础知识

- 卷积神经网络

- 循环神经网络

- TensorBoard 可视化

- TensorFlow - 词嵌入

- 单层感知器

- TensorFlow - 线性回归

- TFLearn 及其安装

- CNN 和 RNN 的区别

- TensorFlow - Keras

- TensorFlow - 分布式计算

- TensorFlow - 导出

- 多层感知器学习

- 感知器的隐藏层

- TensorFlow - 优化器

- TensorFlow - XOR 实现

- 梯度下降优化

- TensorFlow - 构建图

- 使用 TensorFlow 进行图像识别

- 神经网络训练建议

- TensorFlow 有用资源

- TensorFlow - 快速指南

- TensorFlow - 有用资源

- TensorFlow - 讨论

TensorFlow - 数学基础

在 TensorFlow 中创建基本应用程序之前,了解 TensorFlow 所需的数学概念非常重要。数学被认为是任何机器学习算法的核心。借助数学的核心概念,可以定义特定机器学习算法的解决方案。

向量

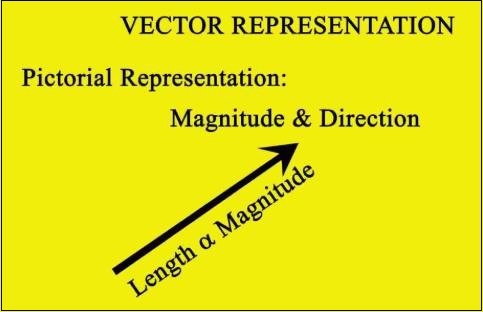

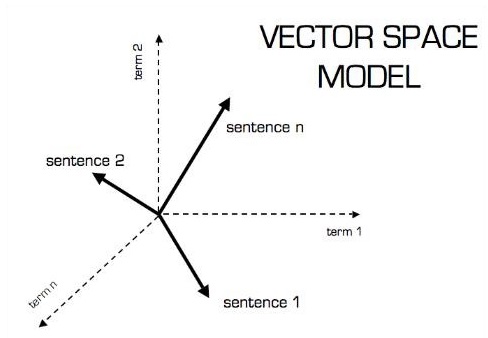

一个数字数组,可以是连续的或离散的,被定义为向量。机器学习算法处理固定长度的向量以获得更好的输出生成。

机器学习算法处理多维数据,因此向量起着至关重要的作用。

向量模型的图形表示如下所示:

标量

标量可以定义为一维向量。标量是指仅包含大小而不包含方向的量。对于标量,我们只关注大小。

标量的示例包括儿童的体重和身高参数。

矩阵

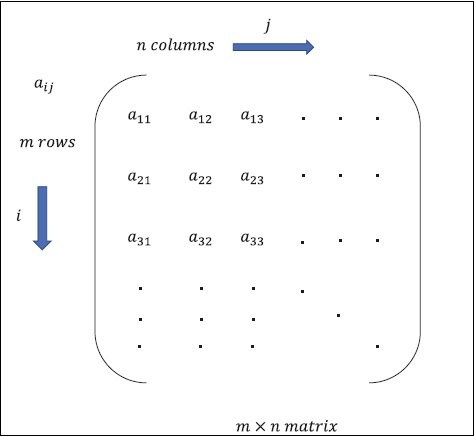

矩阵可以定义为多维数组,以行和列的形式排列。矩阵的大小由行长和列长定义。下图显示了任何指定矩阵的表示。

考虑上面提到的具有“m”行和“n”列的矩阵,矩阵表示将指定为“m*n 矩阵”,这也定义了矩阵的长度。

数学计算

在本节中,我们将学习 TensorFlow 中的不同数学计算。

矩阵加法

如果矩阵具有相同的维度,则可以对两个或多个矩阵进行加法。加法意味着根据给定位置对每个元素进行加法。

考虑以下示例以了解矩阵加法的工作原理:

$$示例:A=\begin{bmatrix}1 & 2 \\3 & 4 \end{bmatrix}B=\begin{bmatrix}5 & 6 \\7 & 8 \end{bmatrix}\:那么\:A+B=\begin{bmatrix}1+5 & 2+6 \\3+7 & 4+8 \end{bmatrix}=\begin{bmatrix}6 & 8 \\10 & 12 \end{bmatrix}$$

矩阵减法

矩阵的减法操作方式类似于两个矩阵的加法。用户可以减去两个矩阵,前提是维度相等。

$$示例:A-\begin{bmatrix}1 & 2 \\3 & 4 \end{bmatrix}B-\begin{bmatrix}5 & 6 \\7 & 8 \end{bmatrix}\:那么\:A-B-\begin{bmatrix}1-5 & 2-6 \\3-7 & 4-8 \end{bmatrix}-\begin{bmatrix}-4 & -4 \\-4 & -4 \end{bmatrix}$$

矩阵乘法

对于两个矩阵 A m*n 和 B p*q 可乘,n 应该等于 p。生成的矩阵为:

C m*q

$$A=\begin{bmatrix}1 & 2 \\3 & 4 \end{bmatrix}B=\begin{bmatrix}5 & 6 \\7 & 8 \end{bmatrix}$$

$$c_{11}=\begin{bmatrix}1 & 2 \end{bmatrix}\begin{bmatrix}5 \\7 \end{bmatrix}=1\times5+2\times7=19\:c_{12}=\begin{bmatrix}1 & 2 \end{bmatrix}\begin{bmatrix}6 \\8 \end{bmatrix}=1\times6+2\times8=22$$

$$c_{21}=\begin{bmatrix}3 & 4 \end{bmatrix}\begin{bmatrix}5 \\7 \end{bmatrix}=3\times5+4\times7=43\:c_{22}=\begin{bmatrix}3 & 4 \end{bmatrix}\begin{bmatrix}6 \\8 \end{bmatrix}=3\times6+4\times8=50$$

$$C=\begin{bmatrix}c_{11} & c_{12} \\c_{21} & c_{22} \end{bmatrix}=\begin{bmatrix}19 & 22 \\43 & 50 \end{bmatrix}$$

矩阵转置

矩阵 A 的转置,m*n 通常表示为 AT(转置)n*m,通过将列向量转置为行向量获得。

$$示例:A=\begin{bmatrix}1 & 2 \\3 & 4 \end{bmatrix}\:那么\:A^{T}\begin{bmatrix}1 & 3 \\2 & 4 \end{bmatrix}$$

向量的点积

任何维度为 n 的向量都可以表示为矩阵 v = R^n*1。

$$v_{1}=\begin{bmatrix}v_{11} \\v_{12} \\\cdot\\\cdot\\\cdot\\v_{1n}\end{bmatrix}v_{2}=\begin{bmatrix}v_{21} \\v_{22} \\\cdot\\\cdot\\\cdot\\v_{2n}\end{bmatrix}$$

两个向量的点积是对应分量的乘积之和 - 沿相同维度的分量,可以表示为

$$v_{1}\cdot v_{2}=v_1^Tv_{2}=v_2^Tv_{1}=v_{11}v_{21}+v_{12}v_{22}+\cdot\cdot+v_{1n}v_{2n}=\displaystyle\sum\limits_{k=1}^n v_{1k}v_{2k}$$

下面提到了向量点积的示例:

$$示例:v_{1}=\begin{bmatrix}1 \\2 \\3\end{bmatrix}v_{2}=\begin{bmatrix}3 \\5 \\-1\end{bmatrix}v_{1}\cdot v_{2}=v_1^Tv_{2}=1\times3+2\times5-3\times1=10$$