- TensorFlow 教程

- TensorFlow - 首页

- TensorFlow - 简介

- TensorFlow - 安装

- 理解人工智能

- 数学基础

- 机器学习与深度学习

- TensorFlow - 基础

- 卷积神经网络

- 循环神经网络

- TensorBoard 可视化

- TensorFlow - 词嵌入

- 单层感知器

- TensorFlow - 线性回归

- TFLearn 及其安装

- CNN 和 RNN 的区别

- TensorFlow - Keras

- TensorFlow - 分布式计算

- TensorFlow - 导出

- 多层感知器学习

- 感知器的隐藏层

- TensorFlow - 优化器

- TensorFlow - XOR 实现

- 梯度下降优化

- TensorFlow - 构建图

- 使用 TensorFlow 进行图像识别

- 神经网络训练建议

- TensorFlow 有用资源

- TensorFlow - 快速指南

- TensorFlow - 有用资源

- TensorFlow - 讨论

神经网络训练建议

本章将介绍可以使用 TensorFlow 框架实现的神经网络训练的各个方面。

以下是十条可以评估的建议:

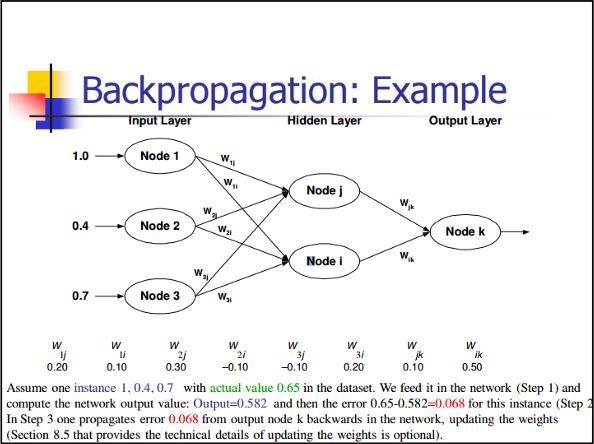

反向传播

反向传播是一种计算偏导数的简单方法,它包括最适合神经网络的基本组合形式。

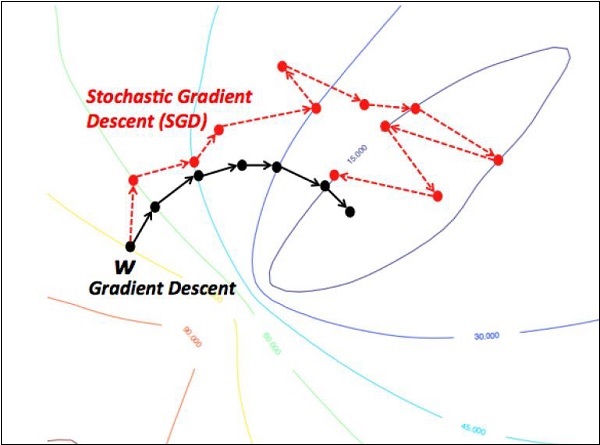

随机梯度下降

在随机梯度下降中,一个批次是用户在单次迭代中用来计算梯度的示例总数。到目前为止,假设批次是整个数据集。最好的例子是在谷歌规模的工作;数据集通常包含数十亿甚至数百亿个示例。

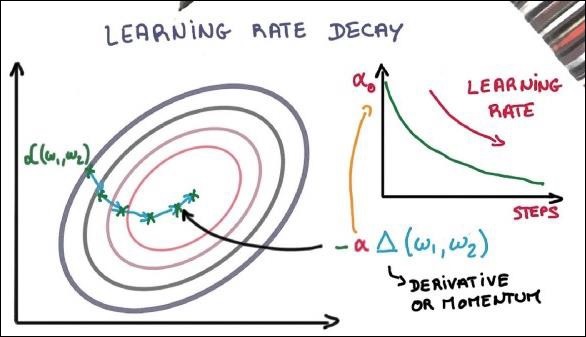

学习率衰减

调整学习率是梯度下降优化的最重要特性之一。这对于 TensorFlow 实现至关重要。

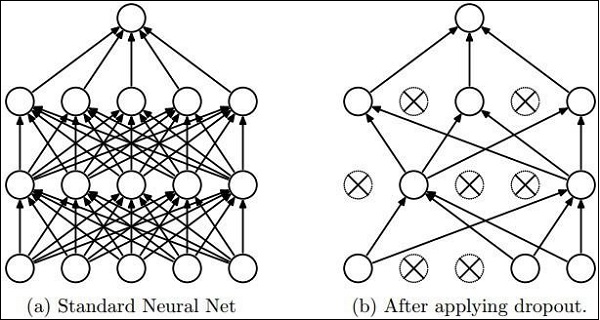

Dropout

具有大量参数的深度神经网络构成了强大的机器学习系统。但是,过拟合是此类网络中的一个严重问题。

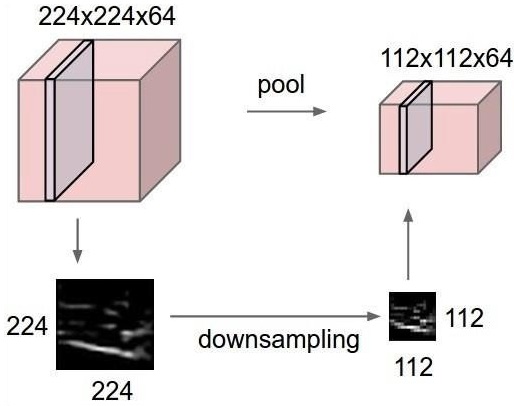

最大池化

最大池化是一种基于样本的离散化过程。目的是对输入表示进行下采样,这在所需的假设下降低了维度。

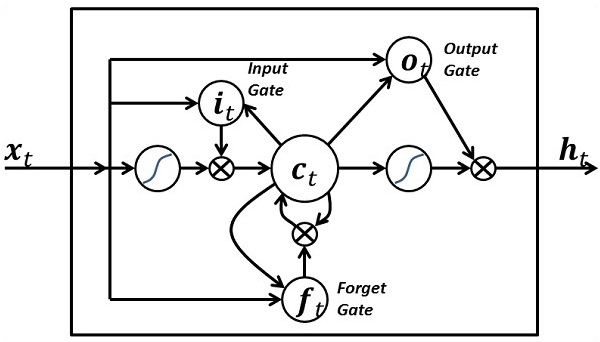

长短期记忆 (LSTM)

LSTM 控制着关于在指定神经元中应采用哪些输入的决策。它包括控制哪些应该计算以及应该生成哪些输出。

广告