- 机器学习基础

- ML - 首页

- ML - 简介

- ML - 入门

- ML - 基本概念

- ML - 生态系统

- ML - Python 库

- ML - 应用

- ML - 生命周期

- ML - 必备技能

- ML - 实现

- ML - 挑战与常见问题

- ML - 限制

- ML - 真实案例

- ML - 数据结构

- ML - 数学

- ML - 人工智能

- ML - 神经网络

- ML - 深度学习

- ML - 获取数据集

- ML - 分类数据

- ML - 数据加载

- ML - 数据理解

- ML - 数据准备

- ML - 模型

- ML - 监督学习

- ML - 无监督学习

- ML - 半监督学习

- ML - 强化学习

- ML - 监督学习与无监督学习

- 机器学习数据可视化

- ML - 数据可视化

- ML - 直方图

- ML - 密度图

- ML - 箱线图

- ML - 相关矩阵图

- ML - 散点矩阵图

- 机器学习统计

- ML - 统计

- ML - 均值、中位数、众数

- ML - 标准差

- ML - 百分位数

- ML - 数据分布

- ML - 偏度和峰度

- ML - 偏差和方差

- ML - 假设

- ML中的回归分析

- ML - 回归分析

- ML - 线性回归

- ML - 简单线性回归

- ML - 多元线性回归

- ML - 多项式回归

- ML中的分类算法

- ML - 分类算法

- ML - 逻辑回归

- ML - K近邻算法(KNN)

- ML - 朴素贝叶斯算法

- ML - 决策树算法

- ML - 支持向量机

- ML - 随机森林

- ML - 混淆矩阵

- ML - 随机梯度下降

- ML中的聚类算法

- ML - 聚类算法

- ML - 基于中心点的聚类

- ML - K均值聚类

- ML - K中心点聚类

- ML - 均值漂移聚类

- ML - 层次聚类

- ML - 基于密度的聚类

- ML - DBSCAN聚类

- ML - OPTICS聚类

- ML - HDBSCAN聚类

- ML - BIRCH聚类

- ML - 亲和传播

- ML - 基于分布的聚类

- ML - 凝聚层次聚类

- ML中的降维

- ML - 降维

- ML - 特征选择

- ML - 特征提取

- ML - 向后剔除法

- ML - 前向特征构造

- ML - 高相关性过滤器

- ML - 低方差过滤器

- ML - 缺失值比率

- ML - 主成分分析

- 强化学习

- ML - 强化学习算法

- ML - 利用与探索

- ML - Q学习

- ML - REINFORCE算法

- ML - SARSA强化学习

- ML - 演员-评论家方法

- 深度强化学习

- ML - 深度强化学习

- 量子机器学习

- ML - 量子机器学习

- ML - 使用Python的量子机器学习

- 机器学习杂项

- ML - 性能指标

- ML - 自动工作流

- ML - 提升模型性能

- ML - 梯度提升

- ML - 自举汇聚(Bagging)

- ML - 交叉验证

- ML - AUC-ROC曲线

- ML - 网格搜索

- ML - 数据缩放

- ML - 训练和测试

- ML - 关联规则

- ML - Apriori算法

- ML - 高斯判别分析

- ML - 成本函数

- ML - 贝叶斯定理

- ML - 精确率和召回率

- ML - 对抗

- ML - 堆叠

- ML - 时期

- ML - 感知器

- ML - 正则化

- ML - 过拟合

- ML - P值

- ML - 熵

- ML - MLOps

- ML - 数据泄露

- ML - 机器学习的盈利化

- ML - 数据类型

- 机器学习 - 资源

- ML - 快速指南

- ML - 速查表

- ML - 面试问题

- ML - 有用资源

- ML - 讨论

机器学习统计

统计学是机器学习中的一项重要工具,因为它可以帮助我们理解数据中潜在的模式。它为我们提供了描述、总结和分析数据的方法。让我们了解一下机器学习统计的一些基础知识。

什么是统计学?

统计学是数学的一个分支,它处理数据的收集、分析、解释和呈现。它为我们提供了各种方法和技术来分析数据并从中得出结论。

统计学是机器学习的基础,因为它可以帮助我们分析和可视化数据以找到隐藏的模式。统计学在机器学习中以多种方式使用,包括模型验证、数据清洗、模型选择、评估模型性能等。

机器学习的基本统计概念

以下是机器学习必不可少的一些重要统计概念:

- 均值、中位数、众数 - 这些统计量用于描述数据集的集中趋势。

- 标准差、方差 - 标准差是衡量一组数据值围绕其均值的离散程度或变异程度的指标。

- 百分位数 - 百分位数是一个指标,表示一组观测值中低于给定百分比观测值的数值。

- 数据分布 - 它指的是数据点在数据集中分布或分散的方式。

- 偏度和峰度 - 偏度指的是分布不对称的程度,峰度指的是分布峰值的程度。

- 偏差和方差 - 它们描述了模型预测中误差的来源。

- 假设 - 它是一种针对问题的提出的解释或解决方案。

- 线性回归 - 它用于根据另一个变量的值预测变量的值。

- 逻辑回归 - 它估计事件发生的概率。

- 主成分分析 - 它是一种降维方法,用于降低大型数据集的维度。

统计学的类型

统计学分为两种类型:描述性统计和推断性统计。

- 描述性统计 - 用于描述或总结数据集特征的一组规则或方法。

- 推断性统计 - 处理根据样本数据对总体进行预测和推断

让我们详细了解这两种类型的统计。

描述性统计

描述性统计是统计学的一个分支,它处理数据的总结和分析。它包括诸如均值、中位数、众数、方差和标准差等度量。这些度量帮助我们了解数据的集中趋势、变异性和分布。

机器学习中的应用

在机器学习中,描述性统计可用于总结数据、识别异常值和检测模式。例如,我们可以使用均值和标准差来描述数据集的分布。

示例

在 Python 中,我们可以使用 NumPy 和 Pandas 等库来计算描述性统计。以下是一个示例:

import numpy as np import pandas as pd data = np.array([1, 2, 3, 4, 5]) df = pd.DataFrame(data, columns=["Values"]) print(df.describe())

输出

这将输出数据集的摘要,包括计数、均值、标准差、最小值和最大值,如下所示:

Values count 5.000000 mean 3.000000 std 1.581139 min 1.000000 25% 2.000000 50% 3.000000 75% 4.000000 max 5.000000

推断性统计

推断性统计是统计学的一个分支,它处理根据样本数据对总体进行预测和推断。它涉及使用假设检验、置信区间和回归分析来对数据得出结论。

机器学习中的应用

在机器学习中,推断性统计可用于根据现有数据对新数据进行预测。例如,我们可以使用回归分析根据房屋特征(如卧室和浴室的数量)来预测房屋的价格。

示例

在 Python 中,我们可以使用 Scikit-Learn 和 StatsModels 等库执行推断性统计。以下是一个示例:

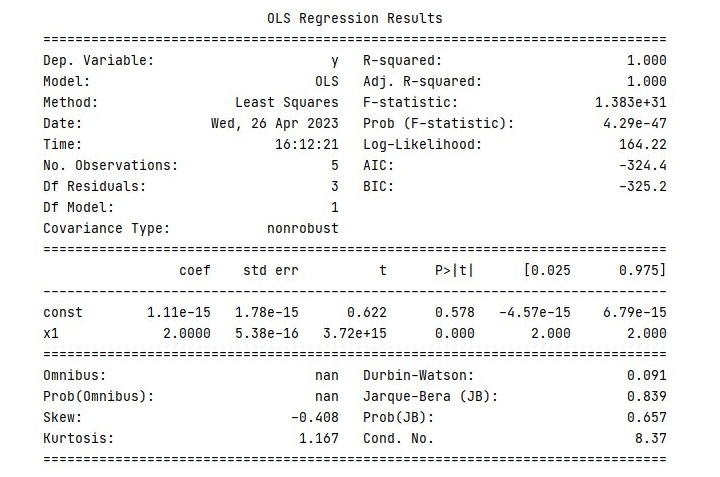

import statsmodels.api as sm import numpy as np X = np.array([1, 2, 3, 4, 5]) y = np.array([2, 4, 6, 8, 10]) X = sm.add_constant(X) model = sm.OLS(y, X).fit() print(model.summary())

输出

这将输出回归模型的摘要,包括系数、标准误差、t统计量和p值,如下所示:

在下一章中,我们将详细讨论机器学习中常用的各种描述性和推断性统计量度,并附带 Python 实现示例。